Nvidia a lansat cipul Groq 3 LPU, care accelerează inferența modelelor AI până la nivel de tokenuri.

Nvidia dezvăluie noi funcționalități ale platformei Vera Rubin

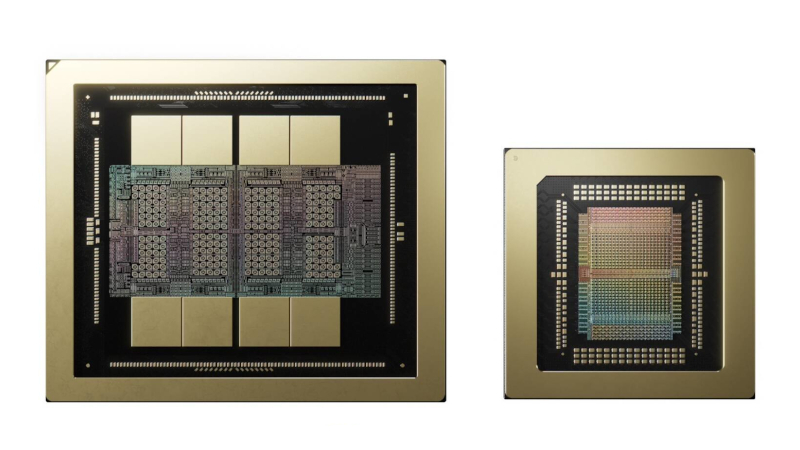

La conferința GTC din acest an, directorul general al Nvidia, Jensen Huang, a anunțat extinderea platformei Vera Rubin. Noile capacități se bazează pe proprietatea intelectuală achiziționată de la compania Groq și în compoziția Rubin a fost adăugat cipul *Groq 3 LPU* – un accelerator de inferență conceput pentru emiterea token-urilor cu viteză mare și latență scăzută.

Ce există deja în Vera Rubin

Platforma este alcătuită din șase componente cheie pe care Nvidia le asamblează în sisteme de tip rack și le scalează la fabrici AI mari:

| Componentă | Descriere |

|---|---|

| GPU Rubin | Placă video cu 288 GB HBM4 |

| CPU Vera | Procesor central |

| NVLink 6 | Sistem de scalare intra-sistem |

| ConnectX‑9 | Adaptator rețea inteligent |

| BlueField‑4 | Procesor de date |

| Spectrum‑X | Switch de scalare inter-sisteme cu optică integrată |

Groq 3 LPU a fost adăugat ca nou bloc constructiv, care va fi utilizat în implementarea sistemelor mari.

De ce se evidențiază Groq 3 LPU

Principala diferență este arhitectura memoriei. În timp ce majoritatea acceleratorilor folosesc HBM ca memorie de lucru, fiecare Groq 3 LPU conține 500 MB SRAM. Comparație:

| Parametru | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Capacitate | 288 GB | 0,5 GB |

| Banda largă | ~22 TB/s | până la 150 TB/s |

Pentru sarcinile de inferență sensibile la lățimea de bandă, avantajul SRAM este evident. De aceea Nvidia a inclus Groq 3 în Rubin – pentru a crește viteza de emitere a token-urilor.

Rack-ul Groq 3 LPX

În rack se află 256 de cipuri Groq 3 LPU, ceea ce oferă:

* 128 GB SRAM

* 40 PB/s de lățime totală de bandă

* 640 TB/s de interfață intra-sistem

Vicepreședintele pentru soluții hiper-scalabile, Ian Buck, a numit acest rack un coprocesor pentru Rubin, subliniind rolul său în creșterea performanței decodării la fiecare strat al modelului și token.

Impact asupra sistemelor multi-agent

Buck a menționat că Groq 3 LPX va fi un element cheie pentru viitorul pieței AI – sistemele multi-agent. Când agenții schimbă date direct, nu prin chat‑bot-uri, cerințele de răspuns se modifică: de la 100 tokeni/s până la peste 1 500+ tokeni/s și mai mult.

Concurenți și perspective

În text este menționat un competitor – Cerebras, care utilizează Wafer‑Scale Engine (WSE) cu o SRAM uriașă pentru inferență cu latență scăzută. OpenAI a folosit deja Cerebras în modelele sale avansate datorită latenței avantajoase.

Buck a subliniat și faptul că apariția Groq 3 LPU ar putea reduce dependența de acceleratorul Rubin CPX. În timp ce Nvidia se concentrează pe integrarea rack-ului Groq 3 LPX cu platforma, ambele cipuri sunt destinate să întărească inferența fără a necesita volume mari de memorie GDDR7.

Concluzie:

Noul cip Groq 3 LPU și rack-ul său LPX potențează Vera Rubin în segmentul inferenței cu latență scăzută, deschizând drumul către sisteme AI multi-agent mai rapide și concurând cu jucători precum Cerebras.

Asted Cloud

Asted Cloud

Comentarii (0)

Împărtășește-ți opinia — te rugăm să fii politicos și să rămâi la subiect.

Autentifică-te pentru a comenta